Um novo estudo publicado em 24 de março na Radiology, o jornal da Sociedade Radiológica da América do Norte (RSNA), mostra que tanto radiologistas quanto modelos de linguagem multimodal (LLMs) têm dificuldade em distinguir radiografias reais de imagens “deepfake” geradas por inteligência artificial (IA). As descobertas levantam preocupações sobre os riscos apresentados por imagens médicas sintéticas e destacam a necessidade de melhores ferramentas e treinamento para ajudar a proteger a precisão da imagem médica e preparar os profissionais de saúde para reconhecer deepfakes.

Um “deepfake” é um vídeo, foto, imagem ou arquivo de áudio que parece autêntico, mas foi criado ou alterado usando IA.

“Nosso estudo demonstra que essas radiografias deepfake são realistas o suficiente para enganar radiologistas, os especialistas em imagem médica mais altamente treinados, mesmo quando estavam cientes de que imagens geradas por IA estavam presentes,” disse o autor principal do estudo, Mickael Tordjman, M.D., pós-doutorando na Icahn School of Medicine, Mount Sinai, Nova York. “Isso cria uma vulnerabilidade de alto risco para litígios fraudulentos, se, por exemplo, uma fratura fabricada puder ser indistinguível de uma real. Também há um risco significativo de cibersegurança se hackers conseguirem acessar a rede de um hospital e injetar imagens sintéticas para manipular diagnósticos de pacientes ou causar um caos clínico generalizado ao minar a confiabilidade fundamental do registro médico digital.”

Detalhes do Estudo e Teste de Imagens

A pesquisa incluiu 17 radiologistas de 12 instituições em seis países (Estados Unidos, França, Alemanha, Turquia, Reino Unido e Emirados Árabes Unidos). A experiência deles variava de iniciantes a especialistas com até 40 anos de prática. No total, o estudo examinou 264 imagens de raios-X, divididas igualmente entre exames reais e gerados por IA.

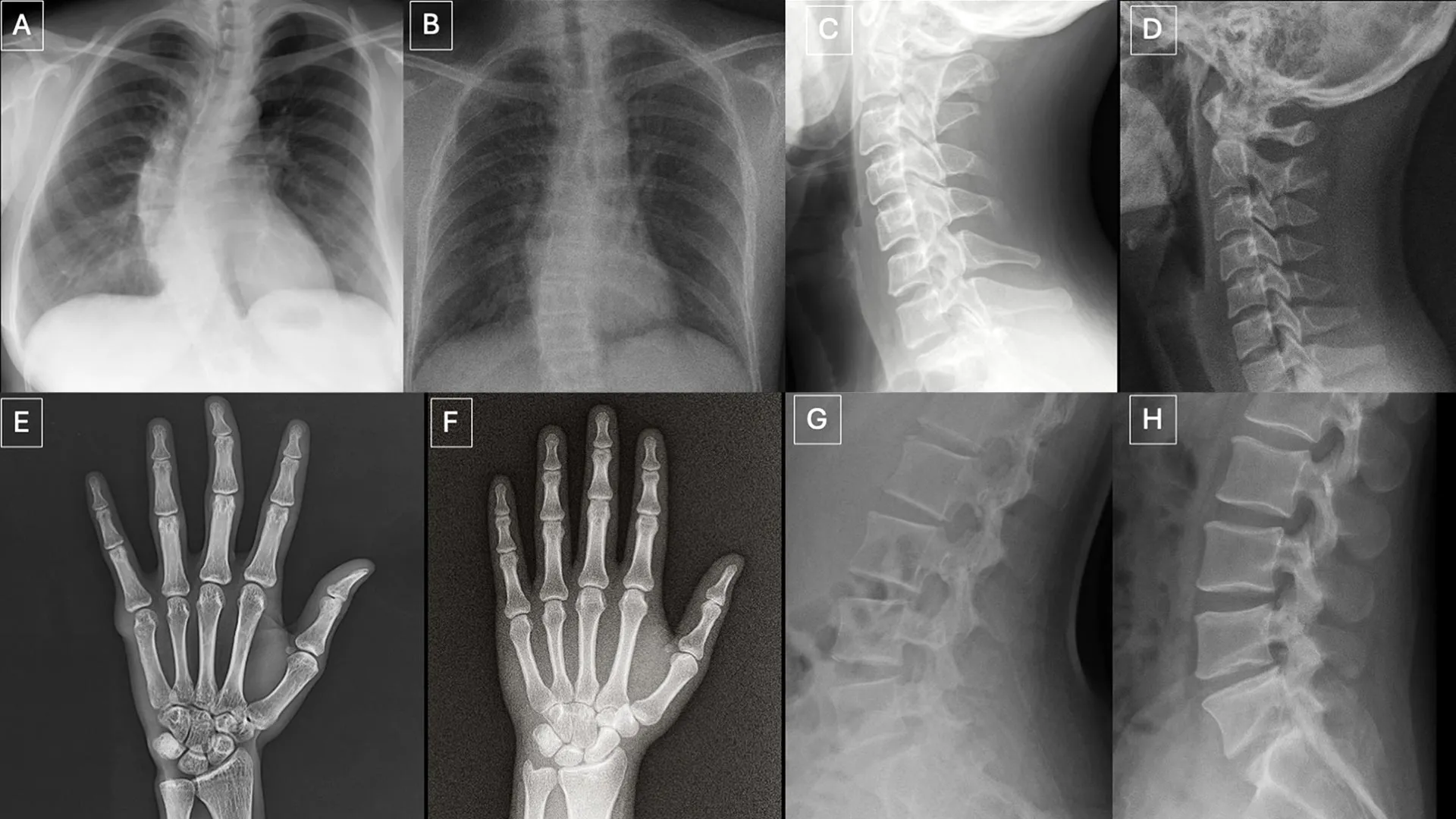

Os participantes revisaram dois conjuntos de imagens separadas, sem sobreposição. Um conjunto continha uma mistura de imagens reais e raios-X gerados pelo ChatGPT de diferentes partes do corpo. O segundo conjunto focava em raios-X de tórax, com metade reais e metade criados usando RoentGen, um modelo de difusão generativa de IA de código aberto desenvolvido por pesquisadores da Stanford Medicine.

Precisão de Detecção para Radiologistas e IA

Quando os radiologistas não foram informados de que imagens falsas estavam incluídas, apenas 41% reconheceram os raios-X gerados por IA após avaliar sua qualidade técnica. Assim que foram informados de que imagens sintéticas estavam presentes, sua precisão média ao distinguir o real do falso subiu para 75%.

O desempenho variou amplamente entre os indivíduos. Radiologistas identificaram corretamente entre 58% e 92% das imagens geradas pelo ChatGPT. Os sistemas de IA mostraram limitações semelhantes. Quatro LLMs multimodais — GPT-4o (OpenAI), GPT-5 (OpenAI), Gemini 2.5 Pro (Google) e Llama 4 Maverick (Meta) — alcançaram taxas de precisão que variavam de 57% a 85%. Mesmo o ChatGPT-4o, que foi usado para gerar as imagens deepfake, não detectou todas elas, embora tenha se saído melhor do que os outros modelos.

Para os raios-X de tórax gerados pelo RoentGen, os radiologistas alcançaram taxas de precisão entre 62% e 78%, enquanto os modelos de IA variaram de 52% a 89%.

A Experiência Não Garante Detecção

O estudo não encontrou nenhuma ligação entre os anos de experiência de um radiologista e sua capacidade de identificar raios-X falsos. No entanto, radiologistas especializados em músculos e esqueleto tiveram um desempenho significativamente melhor do que outros subespecialistas.

Padrões Visuais em Raios-X Deepfake

Os pesquisadores identificaram vários padrões que podem aparecer em imagens sintéticas.

“Imagens médicas deepfake muitas vezes parecem perfeitas demais,” disse Dr. Tordjman. “Os ossos são excessivamente lisos, as colunas vertebrais estritamente retas, os pulmões excessivamente simétricos, os padrões dos vasos sanguíneos excessivamente uniformes, e as fraturas aparecem incomumente limpas e consistentes, muitas vezes limitadas a um lado do osso.”

Riscos e Salvaguardas para Imagens Médicas

Os resultados destacam riscos sérios se raios-X deepfake forem mal utilizados. Imagens fabricadas poderiam ser usadas em casos legais ou inseridas em sistemas hospitalares para influenciar diagnósticos e interromper cuidados.

Para reduzir essas ameaças, os pesquisadores recomendam proteções digitais mais robustas. Isso inclui marcas d’água invisíveis incorporadas diretamente nas imagens e assinaturas criptográficas vinculadas ao tecnólogo no momento da captura da imagem, que podem ajudar a verificar a autenticidade.

O Futuro da IA nas Imagens Médicas

“Estamos potencialmente apenas vendo a ponta do iceberg,” disse Dr. Tordjman. “O próximo passo lógico nesta evolução é a geração de imagens sintéticas 3D, como CT e MRI. Estabelecer conjuntos de dados educacionais e ferramentas de detecção agora é crítico.”

Para apoiar a educação e a conscientização, os pesquisadores divulgaram um conjunto de dados deepfake curado que inclui questionários interativos para fins de treinamento.